Aujourd’hui, on va travailler ensemble sur une nouvelle loi classique (mais hors programme) de probabilité : la loi Gamma. C’est l’occasion pour toi de revoir quelques méthodes avec les probabilités continues (variables aléatoires à densité).

La loi Gamma : une distribution de probabilité

Cette loi est une distribution de probabilité continue sur l’intervalle \(x > 0\). Elle peut être utilisée pour modéliser divers phénomènes tels que la durée de vie d’un système, le temps entre des événements, etc. Il existe deux formes de cette loi : à un paramètre et à deux paramètres.

Au programme, seule la loi Gamma à un paramètre est exigible. Cependant, il n’est pas rare que la loi à deux paramètres tombe dans les sujets de concours. Autant t’y familiariser dès maintenant.

La loi Gamma à un paramètre

La fonction de densité de probabilité de la loi Gamma à un paramètre est donnée par :

\begin{equation} f(x; \alpha) = \frac{1}{\Gamma(\alpha)} x^{\alpha – 1} e^{-x}, \quad x > 0 \end{equation}

Où \(\alpha\) est le seul paramètre et \(\Gamma(\cdot)\) est la fonction gamma.

On rappelle que la fonction gamma est définie par \(\Gamma(x) = \int_{0}^{\infty} t^{x-1} e^{-t} dt\)

On note alors : \(X \hookrightarrow \gamma(\alpha)\)

La loi Gamma à deux paramètres

La fonction de densité de probabilité de la loi Gamma à deux paramètres est donnée par :

\begin{equation} f(x; \alpha, \beta) = \frac{1}{\Gamma(\alpha) \beta^{\alpha}} x^{\alpha – 1} e^{-\frac{x}{\beta}}, \quad x > 0 \end{equation}

Où \(\alpha\) et \(\beta\) sont les paramètres et \(\Gamma(\cdot)\) est la fonction gamma.

La loi Gamma à un paramètre est donc une loi Gamma à deux paramètres avec comme deuxième paramètre 1.

Moments

L’espérance et la variance de la loi à deux paramètres sont données par :

\[\text{E}[X]=\alpha \beta \qquad \text{Var}[X]=\alpha \beta^2\]

On a donc que l’espérance et la variance de la loi à un paramètre sont données par :

\[\text{E}[X]=\alpha \qquad \text{Var}[X]=\alpha \]

Démontrons désormais les résultats pour la loi Gamma à un paramètre (celle qui est au programme).

Espérance

L’espérance d’une loi Gamma à un paramètre est donnée par \(\mathbb{E}[X] = \int_{0}^{\infty} xf_X(x)dx\), où \(f_X(x)\) est la fonction de densité de probabilité de la loi.

Pour la loi à un paramètre, la fonction de densité de probabilité est donnée par :

\(f_X(x) = \frac{1}{\Gamma(\alpha)} x^{\alpha-1}e^{-x}\), où \(\Gamma(\alpha)\) est la fonction gamma.

Alors, en utilisant cette fonction de densité de probabilité, l’espérance de la loi Gamma à un paramètre est donnée par :

\(\mathbb{E}[X] = \int_{0}^{\infty} x\frac{1}{\Gamma(\alpha)} x^{\alpha-1}e^{-x}dx = \frac{1}{\Gamma(\alpha)}\int_{0}^{\infty} x^{\alpha}e^{-x}dx = \frac{\Gamma(\alpha+1)}{\Gamma(\alpha)} = \alpha\)

On a, pour la dernière formule utilisée, le fait que \(\Gamma(\alpha+1) = \Gamma(\alpha)\alpha\)

Variance

La variance est donnée par :

\(\mathrm{Var}[X]=\mathbb{E}[(X-\mathbb{E}[X])^2]=\mathbb{E}[X^2]-\mathbb{E}[X]^2\) d’après König-Huygens.

Pour trouver \(\mathbb{E}[X^2]\), on emploie la même méthode que précédemment et on trouve :

\(\mathbb{E}[X^2] = \int_{0}^{\infty} x^2\frac{1}{\Gamma(\alpha)} x^{\alpha-1}e^{-x}dx = \frac{1}{\Gamma(\alpha)}\int_{0}^{\infty} x^{\alpha+1}e^{-x}dx = \frac{\Gamma(\alpha+2)}{\Gamma(\alpha)} = \alpha (\alpha+1)\)

Donc, \(\mathrm{Var}[X]= \alpha (\alpha+1) – \alpha^2 = \alpha\)

Propriétés de la loi à un paramètre

Nous allons ensuite voir des propriétés (au programme) intéressantes de la loi Gamma à un paramètre.

Stabilité par somme

Si X et Y sont des variables aléatoires indépendantes suivant une loi Gamma avec les paramètres respectifs \(\alpha_1\) et \(\alpha_2\), alors la variable aléatoire \(Z = X + Y\) suit une loi avec le paramètre \(\alpha_1 + \alpha_2\) :

\[Z \hookrightarrow \gamma(\alpha_1 + \alpha_2)\]

On peut généraliser par récurrence et on a ainsi que :

Si \(X_1, X_2, …, X_n\) sont des variables aléatoires indépendantes suivant une loi Gamma avec les paramètres respectifs \(\alpha_1\), \(\alpha_2\), …, \(\alpha_n\), alors la variable aléatoire \(Z = X_1 + X_2 + … + X_n\) suit une loi Gamma avec le paramètre \(\alpha_1 + \alpha_2 + … + \alpha_n\) :

\[Z \hookrightarrow \gamma(\displaystyle \sum_{i=1}^{n}\alpha_k)\]

Lien avec la loi exponentielle

Une loi exponentielle de paramètre 1 est une loi Gamma de paramètre 1. Il suffit de regarder les fonctions de densité et leur univers pour s’en persuader.

Trouver la densité d’une somme de variables suivant une loi exponentielle

On peut se servir des deux propriétés précédentes pour déterminer la densité d’une somme de variables aléatoires suivant des lois exponentielles.

Si \(X_1, X_2, …, X_n\) sont des variables aléatoires indépendantes suivant une loi exponentielle avec toutes le même paramètre \(\lambda\), on a alors que \(\forall i \in [\![1,n]\!], \lambda X_i \hookrightarrow \mathcal{E}(1) \Rightarrow \lambda X_i \hookrightarrow \gamma(1)\)

Ainsi, \(\lambda \displaystyle \sum_{i=1}^{n}X_i \hookrightarrow \gamma(n)\)

Il ne reste donc plus qu’à faire un changement affine pour déterminer la densité de la variable \(Z=\displaystyle \sum_{i=1}^{n}X_i\)

La loi Gamma dans les sujets de concours

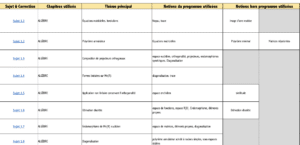

Voici quelques sujets de concours où cette loi apparaît de façon non négligeable. Cette liste est très loin d’être exhaustive :

N’hésite pas à consulter toutes nos autres ressources mathématiques !